实时更新中芯汇金最新动态,了解中芯汇金

发布时间 :2023-07-03 10:36:34

Ziad Asghar 表示,“我们正在引领混合 AI 愿景的实现。对隐私和安全要求比较高的终端侧工作负载,可以继续通过边缘云,完全在终端侧完成。对于其它的模型工作,我们也可以和云服务供应商合作完成。通过在云端和边缘侧终端分布工作负载,我们能够大幅度减少云端的处理量。混合 AI 的优势在于,即使不同终端处理能力不尽相同,但仍然能够提供相近的体验,同时带来包括成本、能耗、隐私与安全、个性化等优势;还能通过出色的 5G 连接技术确保信息在端到端之间进行高效传输。”

混合 AI 对生成式 AI

具体来说,混合 AI 指终端和云端协同工作,在适当的场景和时间下分配 AI 计算的工作负载,以提供更好的体验,并高效利用资源。在一些场景下,计算将主要以终端为中心,在必要时向云端分流任务。而在以云为中心的场景下,终端将根据自身能力,在可能的情况下从云端分担一些 AI 工作负载。混合 AI 架构 (或仅在终端侧运行 AI),能够在全球范围带来成本、能耗、性能、隐私、安全和个性化优势。

利用边缘侧终端规模化

在以终端为中心的混合AI架构中,云端仅用于处理终端侧无法充分运行的AI任务。

随着强大的生成式 AI 模型不断缩小,以及终端侧处理能力的持续提升,混合 AI 的潜力将会进一步增长。参数超过 10 亿的 AI 模型已经能够在手机上运行,且性能和精度达到与云端相似的水平。不久的将来,拥有 100 亿或更高参数的模型将能够在终端上运行。

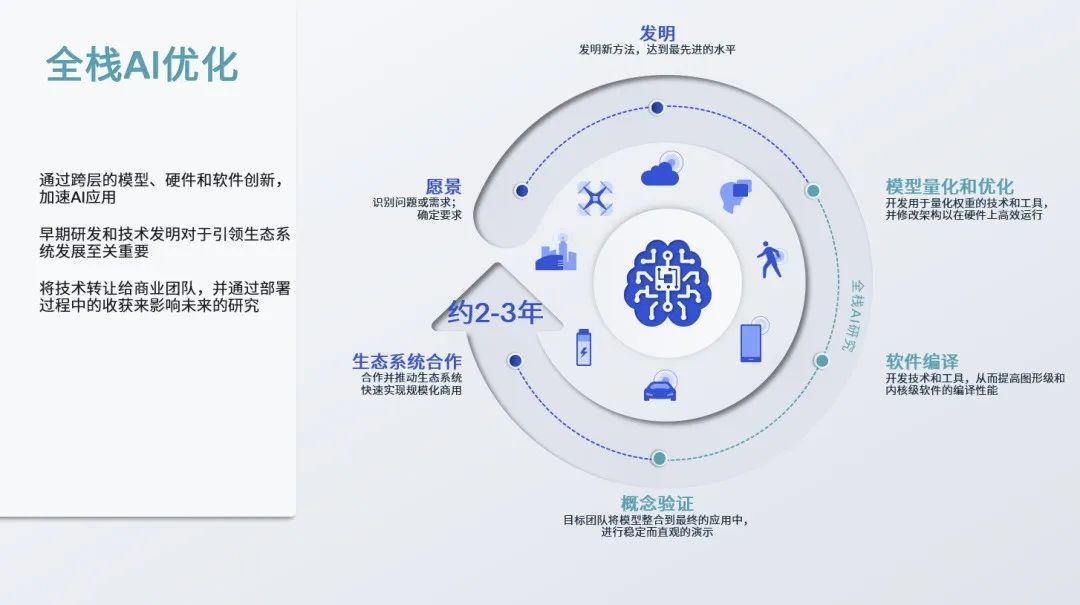

全栈 AI 优化

Ziad Asghar 表示,在云端服务器上训练的模型一般采用 32 位浮点运算(FP32),这意味着完成模型推理需要大量的处理工作。“我们希望通过整数运算模式和量化技术进行 AI 推理,即时获取模型推理结果。针对 Stable Diffusion,我们所采用的是 8 位整数运算(INT8)。去年年底在第二代骁龙 8 移动平台上,我们已经进一步支持了 4 位整数运算(INT4)能力。我们的硬件、软件以及工具设计也都考虑了如何充分利用这一关键优势。”

目前高通能够支持 Stable Diffusion 这一超过 10 亿参数的模型在终端侧运行,但许多关键的生成式 AI 模型,比如文本生成图像、自然语言处理、编程、图像理解、图像创作等,模型规模一般在 10 亿到 100 亿参数之间。Ziad Asghar 表示未来几个月内,高通将有望支持参数超过 100 亿的模型在终端侧运行。

对话 Ziad Asghar:

在媒体沟通会上,Ziad Asghar 接受了 InfoQ 在内的部分媒体采访。以下为采访实录,经编辑。

问:刚才说到,高通在几个月之后就可以实现在终端侧处理参数规模达 100 亿的模型,你们会用什么样的大语言模型?

Ziad Asghar:我们看到目前大语言模型的模态非常丰富,并且已经出现了多模态模型,包括文本生成图片、文本生成文本、文本生成视频,甚至还有图片生成文本、图片生成视频等方式。这将揭开新的序幕,开启许多人们未曾想象过的全新用例。我们已经开始面向不同场景和用例需求的模型展开工作。

问:对于文本生成文本模型,会不会考虑使用来自于 Meta 的开源 LLaMA 模型?

Ziad Asghar:我们对模型的应用持有非常开放的态度。针对中国市场的模型,我们会专注于面向本地语言和使用场景的模型调优和训练,以让用户能够根据不同的需求,随时随地地使用模型。我们当前在关注不同的开源模型,同时我们也将与众多的中国合作伙伴携手,实现这些模型在本土市场的终端侧部署。

问:智能手机端侧运行生成式 AI 会成为未来的大趋势吗?

Ziad Asghar:我们认为这将是一个非常值得期待的重要趋势。所有不同的终端在生成式 AI 的助力之下,将为消费者带来更强大的吸引力。终端的可用性、娱乐性和生产力价值将远远超越当前的水平。

问:您刚刚提到的 Stable Diffusion 成功在安卓手机上运行,不到 15 秒生成图片,这个是完全在终端侧上就能运行吗?我们大约什么时候能用上?以什么样的方式用上?

Ziad Asghar:目前我们已经能够完全在终端侧运行 Stable Diffusion,无需连接云端,即使是将手机调到飞行模式也可以。但是目前只有采用高通技术的终端能够实现。对于具体的用例,举例来说,我们可以将 Stable Diffusion 的能力集成到相机应用中,用户在任何一个地点拍摄照片,再提出需求,例如将照片背景改为夕阳之下的万里长城,Stable Diffusion 就能够完成这一任务。此外还有其他的用例,比如数字助手、生产力应用等。我们相信通过与合作伙伴的共同努力,用户将能在今年体验到这些终端侧用例。

问:高通实现终端侧运行 AI 大模型,在硬件、软件层面的核心技术优势是什么?未来基于其他移动芯片平台的产品是否也会跟进这一能力?

Ziad Asghar:长期以来,高通致力于持续基于我们所打造的硬件、软件和工具资源,驱动生成式 AI 在终端侧的规模化扩展。首先在硬件方面,我们在既定功耗下的处理能力领先于市场上的其他竞争对手,这让我们能够在运行生成式 AI 用例时实现非常出色的表现。凭借我们的研究投入,我们能够在终端侧利用量化技术,在处理相同用例时大幅节省功耗和算力,同时完全不影响准确性,这是我们的竞争对手做不到的。另外一个优势在软件方面,我们提供高通 AI 引擎 Direct 以及 Qualcomm AI Studio 等软件工具,让这些模型能够完全在终端侧运行。

问:以聊天机器人对代表的生成式 AI 应用要有好的使用体验,一个比较大的挑战是时延,每个指令(token)的时延需要在毫秒级别,如何才能将这类应用部署在终端侧,并且拥有不错的体验?

Ziad Asghar:我们能够提供非常高效的 token 生成速率,完全不会因为时延影响到用户的体验。时延对于用户体验的确至关重要,而得益于我们的技术,我们的每秒 token 生成速率能够为用户提供流畅的体验。

问:高通的 AI 硬件在处理 AI 应用时比 CPU 有明显优势,接下来是否会增加 transformer 核心让端侧生成式 AI 的体验更好?

Ziad Asghar:高通 AI 引擎涵盖了 CPU、GPU 以及 Hexagon 处理器,从而能够在最合适的位置进行 AI 处理。谈到在高通 AI 硬件上进行 AI 处理的优势,除了我们的硬件引擎有着非常强大的处理能力外,我们也在去年推出了专门面向 transformer 处理的领先技术,能够大幅提升 transformer 处理效率。所以在硬件层面我们的技术已经完备,能够支持在终端侧获得大幅提升的 transformer 处理表现。

问:我们注意到高通今天正式将自研 AI 技术的起步时间点定在了“十年前”,也就是曾经的 Zeroth 处理器。我们想知道,当年 Zeroth 的 SNN 网络架构在如今的骁龙移动平台上得到了多大程度的继承?

Ziad Asghar:高通长期专注于脉冲神经网络(SNN)研究,骁龙 820 平台是我们最先应用这一技术的产品。我们的大量工作也得益于这一技术研究,我们在这一技术基础之上不断积累,覆盖了各个领域,包括技术、硬件增强和软件等等。我认为这也是我们今天能够在终端侧取得如此领先和丰富的 AI 能力的原因之一。

问:您认为目前的 AI 大模型在 C 端和 B 端,哪侧会更快落地?

Ziad Asghar:我认为应该会在 C 端和 B 端同步落地,同时高通也有能力来支持这些模型落地。无论是智能手机、VR、AR 还是汽车等面向消费者的智能设备,亦或是企业级的搭载骁龙计算平台的 PC、智能手机等设备。我们的产品和技术能够支持面向专业领域的 GPT 模型以及丰富的模型模态(比如文本生成图片等),这能够为 C 端和 B 端都带来巨大可能性,为所有人带来出色体验,无论是在家中还是在工作场所。甚至只要人们用手机,就可以感受到 AI 带来的优势。

问:生成式 AI 在汽车座舱、智能驾驶上的应用进展如何?需要调用数据量和模型形式和手机端有哪些本质不同?边缘侧的低功耗、低时延,是结合 5G 座舱芯片或大算力芯片共同实现的吗?

Ziad Asghar:第一个问题,关于生成式 AI 赋能的数字座舱体验,大家可以想象一下,用户可以体验到真正意义上的“和自己的车对话”。你可以告诉你的车:导航带我去机场,但是在去机场的路上,我要找个地方吃个汉堡,再找个地方喝某种口味的咖啡,顺便把我之前干洗的衣服取了。在数字座舱里,我们可以为用户提供真正意义上的虚拟助手。对于汽车应用的不同模态,其要求会更加严格,并且需要更高的准确性。因为与其他商用终端不同,在汽车里出现任何一个小错误都可能带来非常严重的后果。所以我们在确保提供最佳体验的同时,也要确保极高的准确性。

第二个问题,在汽车领域我们需要将多模态相结合,同时结合雷达、激光雷达、以及摄像头等传感器数据,从而让我们在使用生成式 AI 规划路线时,获得最佳的效果。

第三个问题,汽车需要非常强大的处理能力。一方面,汽车领域的生成式 AI 用例需要非常丰富的终端侧处理能力,同时,它还需要通过高速低时延的 5G 连接,在需要的情况下利用云端资源进行处理。与我们其他产品线的产品相比,我们的汽车产品通常能够提供更多的生成式 AI 处理能力。

问:目前在 PC 以及其他平台上,NPU 通常是一个独立于 CPU、GPU 的计算单元。但是在骁龙移动平台上,CPU、GPU、DSP、ISP、甚至调制解调器都具备一定的 AI 计算能力,这就意味着骁龙平台的 AI 计算架构实际上是一种分布式的设计。那么这是否会加大软件开发的难度?或者是否会出现某些应用不能完整调用全部 AI 计算单元的情况?

Ziad Asghar:我们的平台采用的是异构计算架构,高通 AI 引擎包括 Hexagon 处理器、CPU、GPU 以及 ISP。我们相信 AI 是能够赋能整个平台的通用技术,无论是摄像头还是图像、调制解调器、视频、音频、语音等等都可以利用 AI 技术。同时,基于我们在软件方面进行的大量投入,无论要在终端侧运行何种应用,高通 AI 引擎都能提供充沛、强大的算力。

问:终端设备上的 AI 模型是否对用户的个人数据进行处理?

Ziad Asghar:针对用户所担心的个人隐私数据保护,终端侧处理恰恰能够解决这一问题。正如我刚刚所讲,无论是 10 亿参数的模型,还是 100 亿参数的模型,如果我们能够完全在终端侧来运行,比如用户发出一个查询,终端接收之后能够独立完成推理,那么所有相关的查询信息和数据都会留在终端上,不会离开终端,这也是边缘处理相对于云端处理的独特优势所在,因为如果要在云端进行查询,那么数据就要先发送到云端,处理完再从云端回到终端。

来源:AI前线、人工智能学家